Вот уже месяц жизнь колонии мух, расположенной в городе Дулут, Миннесота, США, полностью зависит от работы программного обеспечения. Речь идет о самообучающейся слабой форме ИИ, которая целиком и полностью обеспечивает жизнь насекомых внутри специального сосуда. В частности, ИИ предоставляет мухам питание (сухое молоко с сахаром) и воду.

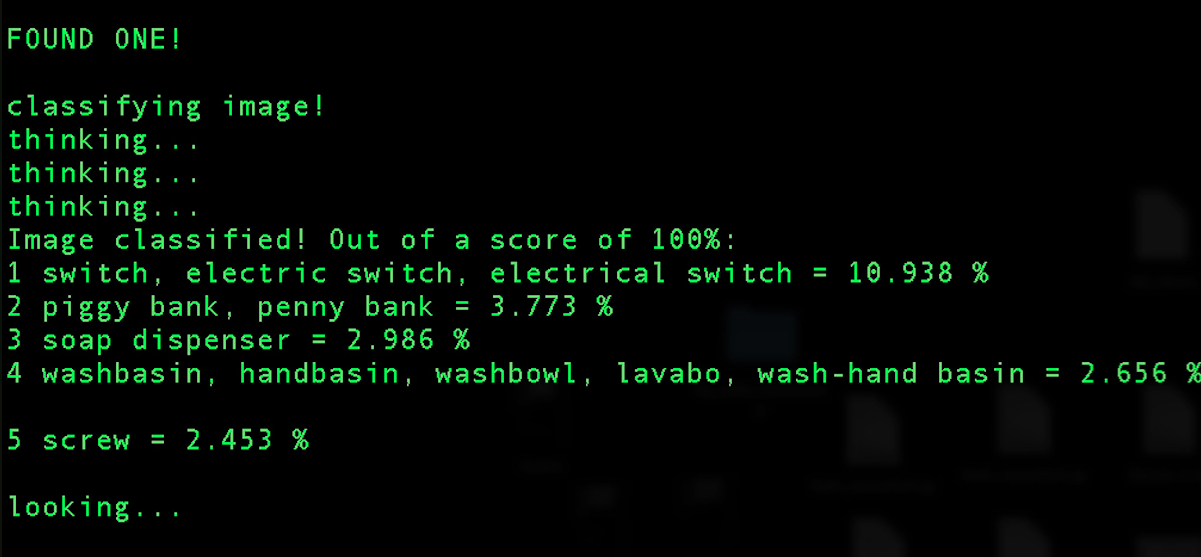

Жизнь насекомых зависит от того, насколько корректно компьютер идентифицирует объект, находящийся перед камерами. Если система определит этот объект, как муху и решит, что насекомым нужна подпитка, они ее получат. В случае ошибки мухи не получат питания и воды и будут страдать (насколько это возможно для мух) от голода и жажды в течение длительного времени. Сам проект получил название FlyAI, это некая пародия на управляемое при помощи компьютера поселение людей. Во всяком случае, так все это видит автор проекта.

«Мы должны давать себе отчет в том, чего можно ожидать от искусственного интеллекта, поскольку в любом случае он появится», — говорит Дэвид Боуэн ( David Bowen) из Университета Миннесоты в Дулуте. Он считает, что необходимо уже сейчас задуматься над тем, что будет представлять собой настоящий искусственный интеллект, чтобы потом не было проблем. По мнению профессора, люди, несмотря на проблемы, смогут сделать так, что ИИ будет полезен человеку и не станет вредить ему.

Центральным элементом проекта FlyAI является самообучающаяся нейронная сеть. Понятно, что, как и большинство современных ИИ-систем, это не идеальный проект. У FlyAI не хватает базы изображений для эффективного обучения. Поэтому периодически система ошибается, идентифицируя мух как выключатели или другие объекты. В случае некорректной идентификации компьютер не «заводит» систему жизнеобеспечения, и мухи голодают и страдают от жажды, о чем уже говорилось выше. Но в любом случае, пока что колония живет, ей уже месяц и мухи чувствуют себя неплохо. Если что-то пойдет совсем неправильно, разработчик системы спасет насекомых, не допустив их массовой гибели. «Они умирают, я думаю, по естественным причинам», — говорит Боуэн. «Они получают возможность здесь состариться».

Проект, по его словам — это стилизованное воплощение мыслей специалиста по ИИ Ника Бострома, работающего в Оксфорде. Бостром считает, что открытость исследований специалистов, работающих над созданием искусственного интеллекта, может стать проблемой. В частности, это касается проекта Open AI, о котором уже публиковалась информация на Geektimes. «Если у вас появилась кнопка „сделать всем плохо“, вряд ли вы захотите поделиться ей со всеми», — заявляет Бостром. Но в случае OpenAI эта кнопка будет доступна всем и каждому.

Впрочем, Бостром считает, что искусственный интеллект должен быть благом для человека. «Для нас важно создать искусственный интеллект, у которого хватит ума учиться на своих ошибках. Он будет способен бесконечно совершенствовать себя. Первая версия сможет создать вторую, которая будет лучше, а вторая, будучи умнее оригинала, создаст ещё более продвинутую третью и так далее. В определённых условиях такой процесс самосовершенствования может повторяться до тех пор, пока не будет достигнут интеллектуальный взрыв – момент, когда интеллектуальный уровень системы подскочит за короткое время с относительно скромного уровня до уровня супер-интеллекта», — заявил он.

А Боуэн утверждает, что риск для человечества представляют не безграничные возможности будущей сильной формы ИИ, а программное обеспечение, от которого будет зависеть (в этом он не сомневается) жизнь человека. «Одна из проблем — это то, что мы даже не до конца понимаем, что такое искусственный интеллект», — говорит Боуэн. «И это выглядит устрашающе».

Сильная форма ИИ, конечно же, будет совсем не похожа на то, что собой представляют современные голосовые поисковые движки и цифровые ассистенты. Возможности искусственного интеллекта, вероятно, будут обширны, но и риски есть. Тот же Стивен Хокинг считает, что ИИ — это величайшая ошибка человечества. Билл Гейтс утверждает, что через несколько десятков лет искусственный интеллект будет уже достаточно развит для того, чтобы представлять собой причину для беспокойства человека. А Илон Маск назвал ИИ «главной угрозой существования человека».

Программная платформа, которая является центром FlyAI, частенько ошибается

Конечно, сам проект может показаться несколько смешным, но его автор так не считает. Собственно, все, что он хотел — это привлечь внимание общественности к своему проекту и проблеме ИИ. Это ему, можно сказать, удалось. В любом случае, мы пока не знаем, когда появится полноценный ИИ, и появится ли он вообще. Это может произойти завтра, а может и через несколько десятков лет. Для того, чтобы быть безопасным для человека, машинный интеллект должен осознавать ценность жизни человека. Все же человек — не муха.

ссылка на оригинал статьи https://geektimes.ru/post/283688/

Добавить комментарий