(Википедия).

Многие знают многоликость Google — это и популярный поисковик, и социальная сеть, а также еще множество других полезных и новаторских сервисов. Но мало кто задумывался: каким образом удалось компании развернуть и поддерживать их со столь высоким быстродействием и отказоустойчивостью? Как организовано то, что обеспечивает такие возможности,— дата-центр Google, каковы его особенности? Как раз об этом и пойдет речь в данной статье.

Собственно, корпорация Google уже давно никого не удивляет мощной динамикой своего роста. Активный борец за «зеленую энергетику», множество патентов в различных областях, открытость и дружественность по отношению к пользователям — вот те первые ассоциации, которые возникают при упоминании Google у многих. Не менее впечатляет и ЦОД компании: это целая сеть дата-центров, размещённых по всему миру, суммарной мощностью220 МВт (по состоянию на прошлый год). Учитывая тот факт, что инвестиции в ЦОД только за последний год составили 2,5 миллиарда долларов, понятно, что компания считает это направление стратегически важным и перспективным. В то же время наблюдается некое диалектическое противоречие, ведь, несмотря на публичность деятельности корпорации Google, его дата-центры являются этаким ноу-хау, тайной, скрытой за семью печатями. В компании считают, что разглашение деталей проектов может быть использовано конкурентами, поэтому лишь часть информации о наиболее передовых решениях просачивается в широкие массы, но даже эта информация весьма интересна.

Собственно, корпорация Google уже давно никого не удивляет мощной динамикой своего роста. Активный борец за «зеленую энергетику», множество патентов в различных областях, открытость и дружественность по отношению к пользователям — вот те первые ассоциации, которые возникают при упоминании Google у многих. Не менее впечатляет и ЦОД компании: это целая сеть дата-центров, размещённых по всему миру, суммарной мощностью220 МВт (по состоянию на прошлый год). Учитывая тот факт, что инвестиции в ЦОД только за последний год составили 2,5 миллиарда долларов, понятно, что компания считает это направление стратегически важным и перспективным. В то же время наблюдается некое диалектическое противоречие, ведь, несмотря на публичность деятельности корпорации Google, его дата-центры являются этаким ноу-хау, тайной, скрытой за семью печатями. В компании считают, что разглашение деталей проектов может быть использовано конкурентами, поэтому лишь часть информации о наиболее передовых решениях просачивается в широкие массы, но даже эта информация весьма интересна.

Начнем с того, что непосредственно сам Google не занимается строительством ЦОД. У него есть департамент, который занимается развитием и сопровождением, а компания сотрудничает с местными интеграторами, которые и выполняют внедрение. Точное количество построенных дата-центров не афишируется, но в прессе их количество варьируется от 35 до 40 по всему миру. Основная концентрация дата-центров приходится на США, Западную Европу и Восточную Азию. Также некоторая часть оборудования размещается и в арендованных помещениях коммерческих ЦОД, имеющих хорошие каналы связи. Известно, что Google использовал площади для размещения оборудования коммерческих дата-центров Equinix (EQIX) и Savvis (SVVS). Google стратегически нацелен на переход исключительно к использованию собственных дата-центров — в корпорации это объясняют растущими требованиями к конфиденциальности информации пользователей, которые доверились компании, и неизбежностью утечки информации в коммерческих дата-центрах. Следуя последним тенденциями, летом этого года было заявлено, что Google будет предоставлять в аренду «облачную» инфраструктуру для сторонних компаний и разработчиков, соответствующую модели IaaS-сервис Compute Engine, который будет предоставлять вычислительные мощности фиксированных конфигураций с почасовой оплатой за пользование.

Основная особенность сети дата-центров не в столько в высокой надежности отдельно взятого дата-центра, сколько в гео-кластеризации. Каждый дата-центр имеет множество высокоемких каналов связи с внешним миром и реплицирует свои данные в несколько других дата-центров, территориально распределенных по миру. Таким образом, даже форс-мажорные обстоятельства вроде падения метеорита существенным образом не повлияют на сохранность данных.

География дата-центров

Первый из публичных дата-центров находится в Дугласе, США. Этот контейнерный ЦОД (рис. 1) был открыт в 2005 году. Этот же дата-центр является наиболее публичным. По сути это некая каркасная конструкция, напоминающая ангар, внутри которой в два ряда расставлены контейнеры. В одном ряду — 15 контейнеров, расположенных в один ярус, и во втором — 30 контейнеров, расположенных в два яруса. В данном дата-центре находится примерно 45 000 серверов компании Google. Контейнеры — 20-футовые морские. На текущий момент введены в работу 45 контейнеров, а мощность ИТ-оборудования составляет 10 МВт. Каждый контейнер имеет собственное подключение к гидравлическому контуру охлаждения, свой блок распределения питания — в нем есть, кроме автоматических выключателей, еще и анализаторы потребления электроэнергии групп электропотребителей для вычисления коэффициента PUE. Отдельно расположены насосные станции, каскады чиллеров, дизель-генераторные установки и трансформаторы. Декларируется PUE, равный 1.25. Система охлаждения — двухконтурная, при этом во втором контуре используются экономайзеры с градирнями, позволяющие значительно снизить время работы чиллеров. По сути это не что иное, как открытая градирня. Вода, забирающая тепло из серверной, подается в верхнюю часть башни, откуда распыляется и стекает вниз. Благодаря распылению воды тепло передается воздуху, который нагнетается извне вентиляторами, а сама вода частично испаряется. Такое решение позволяет значительно сократить время работы чиллеров в дата-центре. Интересно, что первоначально для пополнения запасов воды во внешнем контуре использовалась очищенная водопроводная вода, пригодная для питья. В компании Google быстро поняли, что вода не обязательно должная быть настолько чистой, поэтому была создана система, очищающая сточные воды из близлежащих очистных сооружений и пополняющая запасы воды во внешнем контуре охлаждения.

Внутри каждого контейнера стойки с серверами выстроены по принципу общего «холодного» коридора. Вдоль него под фальшполом находятся теплообменник и вентиляторы, которые выдувают охлажденный воздух через решетки к воздухозаборникам серверов. Нагретый воздух с тыльной части шкафов забирается под фальшпол, проходит через теплообменник и охлаждается, образуя рециркуляцию. Контейнеры оборудованы аварийным освещением, кнопками EPO, дымовыми и температурными датчиками пожарной безопасности.

Рис. 1. Контейнерный ЦОД в Дугласе

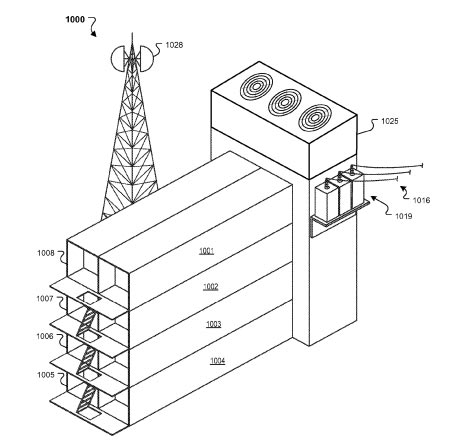

Интересно, что Google впоследствии запатентовал идею «контейнерной башни»: контейнеры ставятся друг на друга, с одной стороны организован вход, а с другого — инженерные коммуникации — системы электроснабжения, кондиционирования и подвод наружных каналов связи (рис. 2).

Рис. 2. Принцип охлаждения воздуха в контейнере

Рис. 3. Запатентованная «контейнерная башня»

Открытый годом позже, в 2006-м, в Далласе (США), на берегу реки Колумбия, дата-центр уже состоял из трех отдельно стоящих зданий, два из которых (каждое площадью 6 400 кв. метров) были возведены в первую очередь (рис.4) — в них расположены машинные залы. Рядом с этими строениями находятся здания, в которых размещены холодильные установки. Площадь каждого здания — 1 700 кв. метров. Кроме этого, в комплексе есть административное здание (1 800 кв. метров) и общежитие для временного проживания персонала (1 500 кв. метров).

Ранее данный проект был известен под кодовым названием Project 02. Следует отметить, что само место для дата-центра было выбрано не случайно: до этого здесь функционировала алюминиевая плавильня мощностью 85 МВт, работа которой была приостановлена.

Рис. 4. Строительство первой очереди ЦОД в Далласе

В 2007 году Google начал строить дата-центр на юго-западе штата Айова — в Каунсил–Блафсе, недалеко от реки Миссури. Концепция напоминает предыдущий объект, однако есть и внешние отличия: здания объединены, а холодильное оборудование вместо охлаждающих башен размещено вдоль обеих сторон основного строения (рис. 5).

Рис. 5. Дата-центр в Каунсил-Блафсе — типовая концепция построения дата-центров Google

Видимо, именно такая концепция была взята в качестве best practices, так как она прослеживается в дальнейшем. Примеры тому — дата-центры в США:

- Ленуар-Сити (Северная Каролина) —здание площадью в 13 000 кв. метров; построен в 2007—2008 гг. (рис. 6);

- Монкс Корнер (Южная Каролина) — открылся в 2008 году; состоит из двух зданий, между которыми зарезервирована площадка под постройку третьего; наличие собственной высоковольтной подстанции;

- Майес Каунти (Оклахома) —строительство затянулось на три года — с 2007 по 2011 год; ЦОД реализовывался в две очереди — каждая включала в себя постройку здания площадью 12 000 кв. метров; электроснабжение дата-центра обеспечивается ветряной электростанцией.

Рис. 6. Дата-центр в Ленуар-Сити

Но первенство по секретности принадлежит дата-центру в Сен-Гислене (рис. 7а). Построенный в Бельгии в 2007—2008 гг., этот дата-центр по размерам превосходит дата-центр в Каунсил-Блафсе. Кроме того, данный ЦОД примечателен тем, что при попытке рассмотреть спутниковую карту Google, вместо него вы увидите пустую площадку в чистом поле (рис. 7б). Google говорит об отсутствии негативного влияния от работы данного ЦОД на окружающие населенные пункты: в качестве воды для градирень в дата-центре используются очищенные сточные воды. Для этого рядом построена специальная станция многостадийной очистки, а вода к станции подводится по техническому судоходному каналу.

Рис. 7а. Дата-центр в Сен-Гислене на карте поисковика bing

Рис. 7б. А вот на карте Google его не существует!

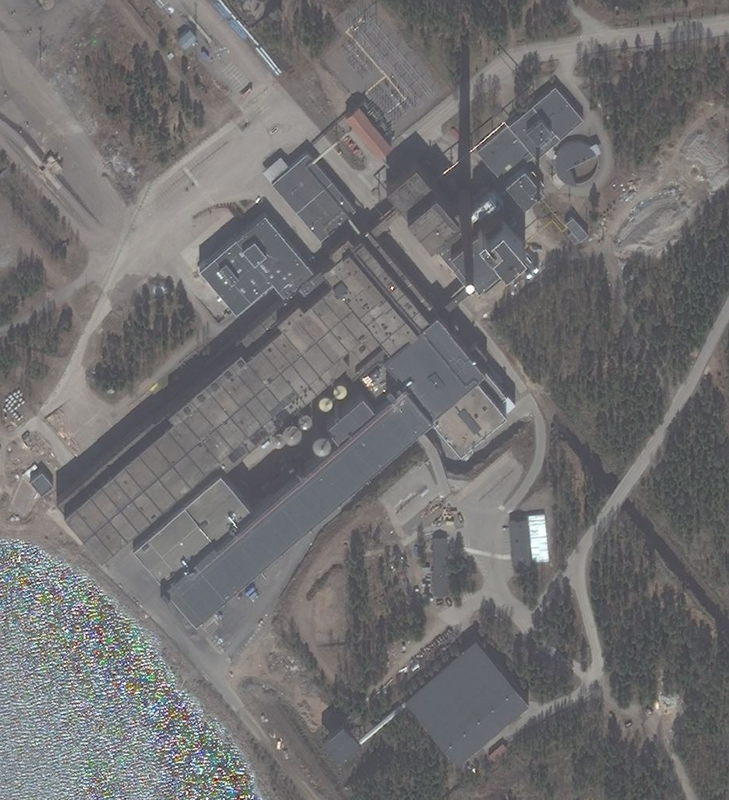

Специалисты Google в процессе строительства отметили, что воду, которая используется для охлаждения наружного контура, было бы логично получать из ее естественного хранилища, а не забирать из водопровода. Корпорация для своего будущего дата-центра приобрела в Финляндии (г. Хамина) старую бумажную фабрику, которая была реконструирована под центр обработки данных (рис. 8). Проект выполнялся в течение 18 месяцев. В его реализации участвовало 50 компаний, а успешный финиш проекта пришелся на 2010 год. В то же время такой размах не случаен: разработанная концепция охлаждения действительно позволила Google заявить еще и о экологичности своих ЦОД. Северный климат в совокупности с низкой точкой замерзания соленой воды позволил обеспечить охлаждение вообще без чиллеров, применив только насосы и теплообменники. Здесь используется типовая схема с двойным контуром «вода — вода» и промежуточным теплообменником. Морская вода закачивается, попадает на теплообменники, охлаждает дата-центр и затем сбрасывается в залив в Балтийском море.

Рис. 8. Реконструкция старой бумажной фабрики в г. Хамина превращает ее в энергоэффективный ЦОД

В 2011 году в северной части Дублина (Ирландия) был построен дата-центр площадью 4 000 кв. метров. Для создания ЦОД было реконструировано уже существовавшее здесь здание склада. Это самый скромный из известных дата-центров, построенных в качестве плацдарма для развертывания сервисов компании в Европе. В этом же году началось развитие сети дата-центров и в Азии: три дата-центра должны появиться в Гонконге, Сингапуре и Тайване. А в этом году Google объявил о покупке земли для постройки дата-центра в Чили.

Примечательно, что в строящемся тайванском ЦОД специалисты Google пошли по-другому пути, решив воспользоваться экономической выгодой от наболее дешевого, ночного тарифа на электроэнергию. Вода в огромных резервуарах охлаждается при помощи чиллерной установки с баками—аккумуляторами холода и используется для охлаждения в дневное время. А вот будет ли тут использоваться фазовый переход теплоносителя или компания остановится только на баке с охлажденной водой — неизвестно. Возможно, после ввода ЦОД в эксплуатацию Google предоставит эту информацию.

Интересно, что полярной идеей является еще более смелый проект корпорации —плавучий ЦОД, который еще в 2008 году запатентовал Google. В патенте указывается, что ИТ-оборудование располагается на плавучем судне, охлаждение выполняется холодной забортной водой, а электричество производится плавучими генераторами, генерирующими электроэнергию от движения волн. Для пилотного проекта планируется использовать плавучие генераторы производства Pelamius: 40 таких генераторов, плавающих на площади 50х70 метров, позволят вырабатывать до 30 МВт электроэнергии, достаточной для работы ЦОД.

Кстати, Google регулярно обнародует показатель энергоэффективности PUE своих дата-центров. Причем интересна сама методика измерения. Если в классическом понимании стандартов Green Grid это отношение потребляемой мощности дата-центра к ее ИТ-мощности, то Google измеряет PUE в целом для объекта, включая не только системы жизнеобеспечения ЦОД, но и потери на преобразование в трансформаторных подстанциях, кабелях, энергопотребление в офисных помещений и т. д. — то есть всего, что находится внутри периметра объекта. Измеренный PUE приводится как усредненное значение для годичного периода. По состоянию на 2012 год усредненный PUE по всем дата-центрам Google составлял 1.13.

Особенности выбора места построения ЦОД

Собственно, понятно, что, строя такие громадные ЦОД, их местоположение Google выбирает не случайно. Какие же критерии в первую очередь учитывают специалисты компании?

- Достаточно дешевая электроэнергия, возможность ее подвода и ее экологически чистое происхождение. Придерживаясь курса на сохранение окружающей среды, компания использует возобновляемые источники электроэнергии, ведь один крупный дата-центр Google потребляет около 50—60 МВт — достаточное количество, чтобы быть единоличным клиентом всей электростанции. Более того, возобновляемые источники позволяют быть независимыми от цен на энергоносители. В настоящее время используются ГЭС и парки ветряков.

- Наличие большого количества воды, которую можно использовать для системы охлаждения. Это может быть как канал, так и естественный водоем.

- Наличие буферных зон между дорогами и населенными пунктами для построения охраняемого периметра и сохранения максимальной конфиденциальности объекта. В то же время требуется наличие магистралей для нормального транспортного сообщения с дата-центром.

- Площадь земли, покупаемой под строительство дата-центров, должна позволять его дальнейшее расширение и постройку вспомогательных зданий либо собственных возобновляемых источников электроэнергии.

- Каналы связи. Их должно быть несколько, и они должны быть надежно защищены. Это требование стало особенно актуально после регулярных проблем пропадания каналов связи в дата-центре, расположенном в Орегоне (США). Воздушные линии связи проходили по ЛЭП, изоляторы на которых стали для местных охотников чем-то вроде мишеней для состязаний в стрельбе. Поэтому в сезон охоты связь с дата-центром постоянно обрывалась, и на ее восстановление требовалось много времени и значительные силы. В итоге проблему решили, проложив подземные линии связи.

- Налоговые льготы. Логичное требование, учитывая, что используемые «зеленые технологии» стоят значительно дороже традиционных. Соответственно, при расчете окупаемости налоговые льготы должны снизить и без того высокие капитальные затраты на первом этапе.

Особенности в деталях

Начнем с серверного парка. Количество серверов не разглашается, но различные источники информации называют цифру от одного до двух миллионов серверов, при этом говорится, что даже последняя цифра не предел, а существующие дата-центры заполнены не полностью (учитывая площади серверных помещений, с этим сложно не согласиться). Серверы выбираются исходя из соотношения цены и качества, а не исходя из абсолютного качества или производительности. Платформа серверов — x86, а в качестве операционной системы используется модифицированная версия Linux. Все серверы объединены в кластерное решение.

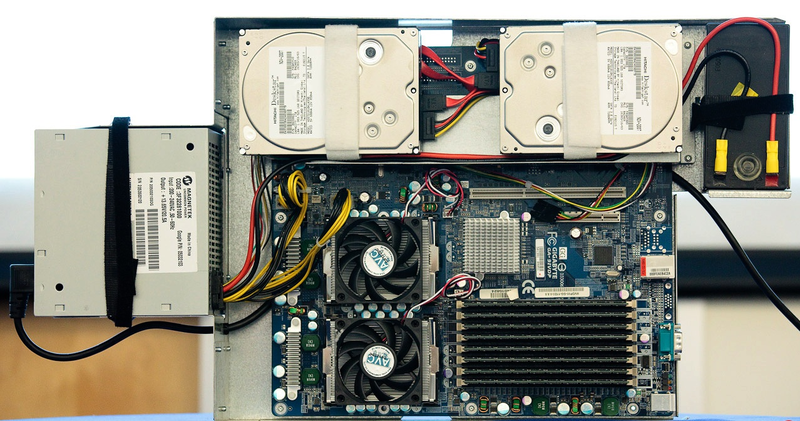

Компания еще в 2000 году задумалась над уменьшением потерь передачи и трансформации электроэнергии в серверах. Поэтому блоки питания соответствуют уровню Gold стандарта Energy Star — КПД блока питания не менее 90%. Также из серверов были убраны все компоненты, которые не требуются для выполнения приложений, работающих на них. К примеру, в серверах отсутствуют графические адаптеры, стоят вентиляторы с контролем оборотов, а компоненты позволяют пропорционально загрузке уменьшать свое энергопотребление. Интересно, что в больших дата-центрах и контейнерных ЦОД, где серверы являются по сути расходным материалом, видимо, было решено: срок жизни серверов сопоставим с жизнью аккумуляторов. А раз так, то вместо ИБП – батарея, которая устанавливается в корпус самого сервера. Так удалось уменьшить потери на ИБП и исключить проблему его низкого КПД при малой нагрузке. Известно, что использовалась двухпроцессорная платформа x86, а производством материнских плат специально для Google занималась небезызвестная компания Gigabyte. Любопытно, что сервер не имеет привычного нам закрытого корпуса: присутствует лишь нижняя его часть, где размещаются жесткие диски, материнская плата, батарея и блок питания (рис. 9). Процесс установки очень прост: администратор вытягивает металлическую заглушку из монтажного поля и вставляет вместо нее сервер, который свободно продувается с фронтальной части на тыльную. После установки выполняется подключение батареи и блока питания.

Состояние и работоспособность каждого жесткого диска сервера отслеживается. Дополнительно выполняется архивация данных на ленточные носители. Своеобразно решена проблема утилизации нерабочих носителей информации — жестких дисков. На первом этапе диски по очереди попадают на некое подобие пресса: металлический наконечник продавливает жесткий диск, спрессовывает камеру с пластинами, чтобы сделать невозможным чтение с них любым имеющимся на данный момент способом. Затем диски попадают в шредер, где их измельчают, и только после этого они могут покинуть территорию дата-центра.

Столь же высокий уровень безопасности и для сотрудников: охрана периметра, бригады быстрого реагирования дежурят круглосуточно, идентификация служащего вначале по пропуску, выполненному с использованием линзовой (лентикулярной) печати, снижающей вероятность подделки, а после — биометрический контроль по радужке глаза.

Рис. 9. Типовой «спартанский» сервер Google — ничего лишнего

Все серверы устанавливаются в 40-дюймовые двухрамные открытые стойки, которые размещаются в ряды с общим «холодным» коридором. Интересно, что в дата-центрах Google не использует специальные конструкции для ограничения «холодного»коридора, а использует навесные жесткие подвижные полимерные ламели, уверяя, что это простое и недорогое решение, позволяющее очень быстро доустанавливать в существующие ряды шкафы и при необходимости сворачивать существующие ламели над верхом шкафа.

Известно, что, кроме аппаратного обеспечения, Google использует файловую систему Google File System (GFS), предназначенную для больших массивов данных. Особенность этой системы в том, что она кластерная: информация делится на блоки по 64 Мбайт и хранится минимум в трех местах одновременно с возможностью находить реплицированные копии. Если какая-то из систем выйдет из строя, реплицированные копии находятся автоматически, с помощью специализированных программ модели MapReduce. Сама модель подразумевает распараллелирование операций и выполнение задач на нескольких машинах одновременно. При этом внутри системы информация шифруется. Система BigTable использует распределенные массивы хранения данных для сохранения большого массива информации с быстрым доступом для хранения, например, веб-индексации, Google Earth and Google Finance. В качестве базовых веб-приложений применяются Google Web Server (GWS) и Google Front-End (GFE), использующие оптимизированное ядро Apache. Все эти системы являются закрытыми и кастомизированными — Google объясняет это тем, что закрытые и кастомизированные системы очень устойчивы против внешних атак и в них значительно меньше уязвимостей.

Подводя итоги, хотелось бы отметить несколько важных моментов, которые не могут не удивлять. Компания Google разумно планирует затраты и стратегию развития дата-центров, применяя понятие «лучшее по цене/качеству» вместо «наилучшее решение». Нет лишнего функционала, нет никаких декоративных излишеств — только «спартанское» наполнение, хотя кому-то это может показаться не эстетичным. Компания активно использует «зеленые» технологии, причем не как самоцель, а как средство для снижения операционных затрат на электроэнергию и штрафов за загрязнение окружающей среды. При построении дата-центров уклон делается не на большое количество резервирования систем — резервируются сами ЦОД (тем самым минимизируется влияние внешних факторов). Основной упор делается на программный уровень и нестандартные решения. Ориентация на возобновляемые источники электроэнергии и использование ресурсов естественных водоемов говорит о том, что компания старается быть максимально независимой от растущих цен на энергоносители. Экологичность применяемых решений хорошо коррелирует с их энергоэффективностью. Все этого говорит о том, что компания Google имеет не только сильную техническую компетенцию, но и умеет правильно инвестировать деньги, смотреть вперед, идя в ногу с тенденциями рынка.

Константин Коваленко журнал ЦОДы.РФ, выпуск №1

ссылка на оригинал статьи http://habrahabr.ru/company/mediagrus/blog/167879/

Добавить комментарий